AI도 전기를 아껴야 하는 시대, 지속가능한 인공지능이란 무엇일까요?

AI는 세상을 바꾸고 있지만, 그 뒤에는 막대한 에너지 소비가 숨어 있습니다.

이제는 성능만큼이나 효율이 중요한 시대입니다.

그 해답은 전력 효율에 초점을 맞춘 지속가능 AI에 있으며,

그 중심에는 파운데이션 모델 구조의 진화가 자리하고 있습니다.

이 글에서는 지속가능 AI의 필요성과 전력 효율적인 파운데이션 모델의 구조,

그리고 AI 기술이 어떻게 더 친환경적으로 나아갈 수 있는지를 살펴보겠습니다.

지속가능한 AI란 무엇인가요?

지속가능한 AI는 단순히 성능을 목표로 하지 않고,

환경적인 영향을 줄이는 방향으로 설계된 인공지능을 의미합니다.

전력 소비를 줄이고, 탄소 배출을 감소시키며, 자원 활용을 극대화하는 데 초점이 있습니다.

최근에는 AI의 학습 및 추론 과정에서 발생하는 에너지 비용을 최소화하는

기술이 활발히 연구되고 있습니다.

파운데이션 모델과 지속가능성의 만남

파운데이션 모델은 수십억 개의 파라미터를 가진 거대한 AI 구조입니다.

이러한 모델은 다목적으로 활용될 수 있지만, 동시에 막대한 연산 자원을 요구합니다.

지속가능성을 확보하기 위해서는 모델 경량화, 효율적인 학습 구조,

그리고 하드웨어 최적화가 필요합니다.

이 세 가지가 전력 효율 기반 AI의 출발점이 됩니다.

전력 효율을 높이는 핵심 기술들

전력 효율을 향상시키는 대표 기술로는 Sparse Attention,

Mixture of Experts, Parameter-Efficient Fine-Tuning(PET) 등이 있습니다.

이 기술들은 필요할 때에만 연산을 수행함으로써 불필요한 계산 낭비를 줄입니다.

| 기술 | 전력 효율에 대한 기여 방식 |

| Sparse Attention | 연산 범위를 제한해 계산량을 감소시킴 |

| Mixture of Experts | 일부 모듈만 활성화하여 전체 연산량 절감 |

| PET (효율적 파인튜닝) | 전체 모델이 아닌 일부만 재학습 수행 |

하드웨어와 소프트웨어 최적화의 조화

전력 효율은 하드웨어와 소프트웨어의 협력으로 이루어집니다.

NVIDIA, AMD와 같은 기업들은 저전력 고성능 GPU를 개발하고 있으며,

소프트웨어 측면에서는 연산 최적화 알고리즘이 적용되고 있습니다.

특히 Transformer 구조의 최적화를 통해 GPU 연산 시간을

30% 이상 단축한 사례도 보고되고 있습니다.

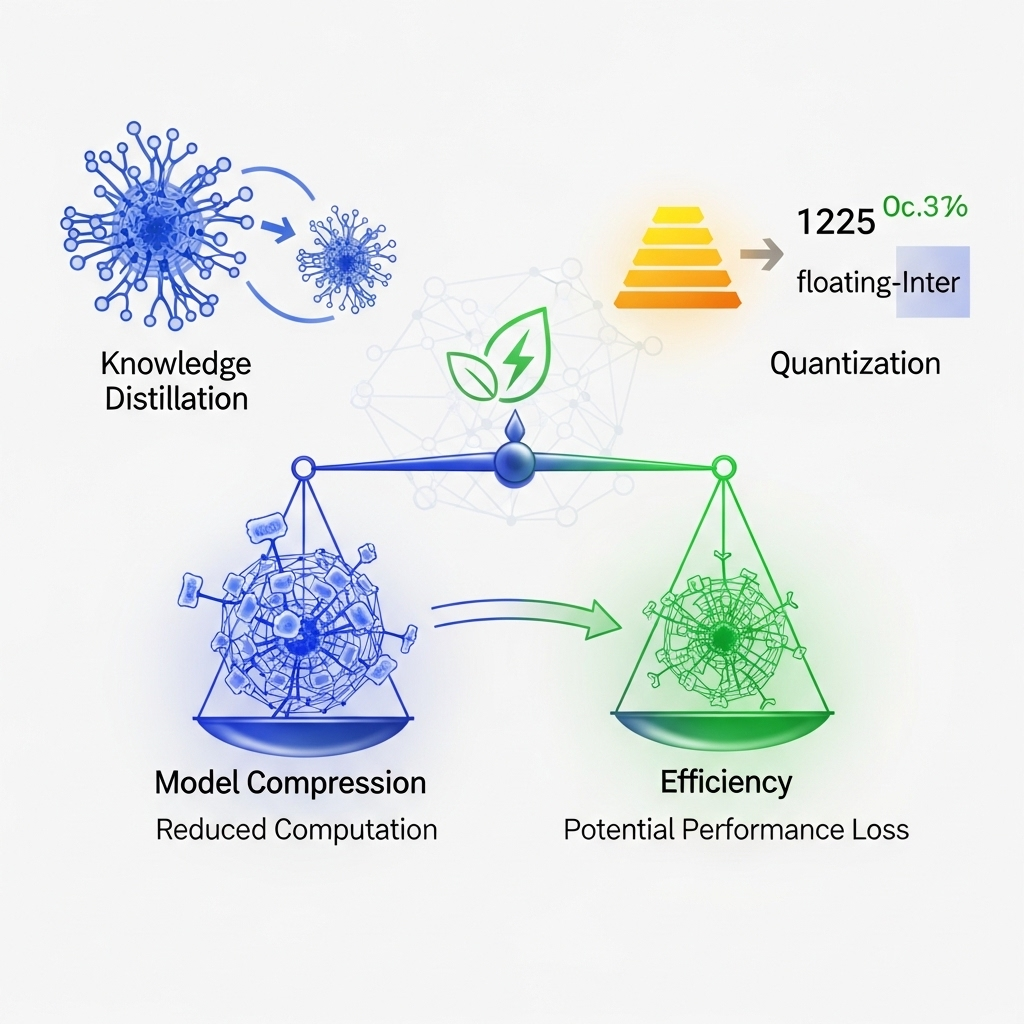

모델 경량화와 효율성, 서로 충돌할까?

모델을 경량화하면 연산량은 줄지만, 성능 저하가 우려됩니다.

이를 해결하기 위해 Knowledge Distillation이나 Quantization 같은 기법이 등장했습니다.

핵심 지식만을 압축하여 전달하거나, 숫자 표현을 단순화하여

계산 효율을 높이는 방식으로 성능과 전력 효율 간의 균형을 맞추게 됩니다.

글로벌 AI 기업들의 지속가능 전략

구글, 메타, 오픈AI와 같은 주요 기술 기업들은

전력 효율 중심의 AI 모델 개발에 막대한 투자를 진행 중입니다.

구글은 TPU 최적화에, 메타는 희소 구조(Sparse Architecture)에,

오픈AI는 파라미터 재활용 및 모델 경량화를 통해

학습 비용을 절감하는 방향으로 나아가고 있습니다.

| 기업 | 지속가능 전략 |

| 구글 | TPU 전력 효율 최적화 |

| 메타 | 희소 구조 모델 활용 |

| 오픈AI | 파라미터 재활용 및 모델 경량화 |

향후 전망: 지속가능 AI가 바꿀 미래

지속가능한 AI는 이제 선택이 아닌 필수가 되었습니다.

AI를 설계할 때부터 환경 영향을 고려해야 하며,

탄소세 등 규제와도 연결될 가능성이 높아지고 있습니다.

앞으로 국가 단위의 인공지능 기술 경쟁에서도

전력 효율이 핵심 전략으로 떠오를 전망입니다.

'재테크' 카테고리의 다른 글

| 뇌를 디지털로 옮길 수 있을까? 신경-AI 인터페이스의 첫걸음 (5) | 2025.08.07 |

|---|---|

| 프로그래밍 LLM의 자동 디버깅 루프, 어디까지 왔나? 최신 연구 동향 총정리 (2) | 2025.08.07 |

| 뉴럴 렌더링과 볼류메트릭 비디오: 상용화는 얼마나 가까워졌을까? (3) | 2025.08.06 |

| 보고, 이해하고, 행동하는 AI: VLA 모델과 Embodied AI의 미래 (0) | 2025.08.05 |

| 개인정보 보호형 LLM 기술: FHE와 차등 프라이버시의 진화 (1) | 2025.08.05 |